Spectacle et interaction intelligente

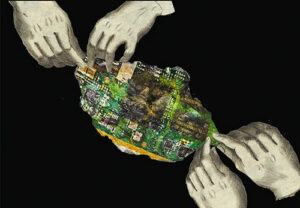

Depuis ses bureaux de Saint-Denis (93), Yannick Kohn, fondateur de Modulo Pi, définit depuis de nombreuses années sa vision du média serveur. Propulsé par les logiciels Modulo Player et Modulo Kinetic, il est souvent le cœur même de représentations, d’animations et d'événements hors du commun à travers le monde. Nous ne citerons que quelques références, que ce soit dans le mapping architectural avec la Grotte Chauvet et la ville de Chartres, dans le corporate et l'événementiel, sur de nombreux défilés de mode, dans les spectacles au Capitole de Toulouse comme au Puy du Fou, sur les comédies musicales (Robin des bois, Oliver Twist et Charlie et la Chocolaterie), comme sur les tournées d'artistes avec le Ballet Béjart, Polnareff et Indochine.

Avec la nouvelle version V5 de son logiciel Modulo Kinetic, Modulo Pi ouvre la voie vers une nouvelle génération de spectacles “intelligents”, en offrant aux artistes et aux technicien.ne.s la possibilité d'interagir avec la vidéo, l’audio, la lumière et la machinerie dans des scénarios interactifs, sans besoin de connaissances particulières en programmation, restant ainsi toujours simple d’utilisation

La suite est réservée aux abonnés

Envie de lire la suite ?

Votre abonnement nous permet de rester indépendants et de continuer à vous informer. Rejoignez-nous !